Ich teste Walter Writes AI für Longform-Inhalte und mache mir Sorgen, ob die Artikel, die es erstellt, tatsächlich aktuelle KI-Content-Detektoren von Kunden, Schulen und Suchmaschinen bestehen können. Einige Tools bewerten den Text als menschenähnlich, während andere ihn als KI kennzeichnen. Kann jemand echte Praxiserfahrungen, konkrete Detektor-Tools, die ihr ausprobiert habt, und praktische Tipps zum Anpassen von Walter-Writes-AI-Inhalten teilen, damit sie sicherer für Veröffentlichungen und SEO sind?

Walter Writes AI – mein ehrliches Fazit nach einigem Herumprobieren

Ich habe einen Nachmittag damit verbracht, Walter Writes AI mit den üblichen AI-Detektoren zu stresstesten, die alle dauernd erwähnen: GPTZero und ZeroGPT.

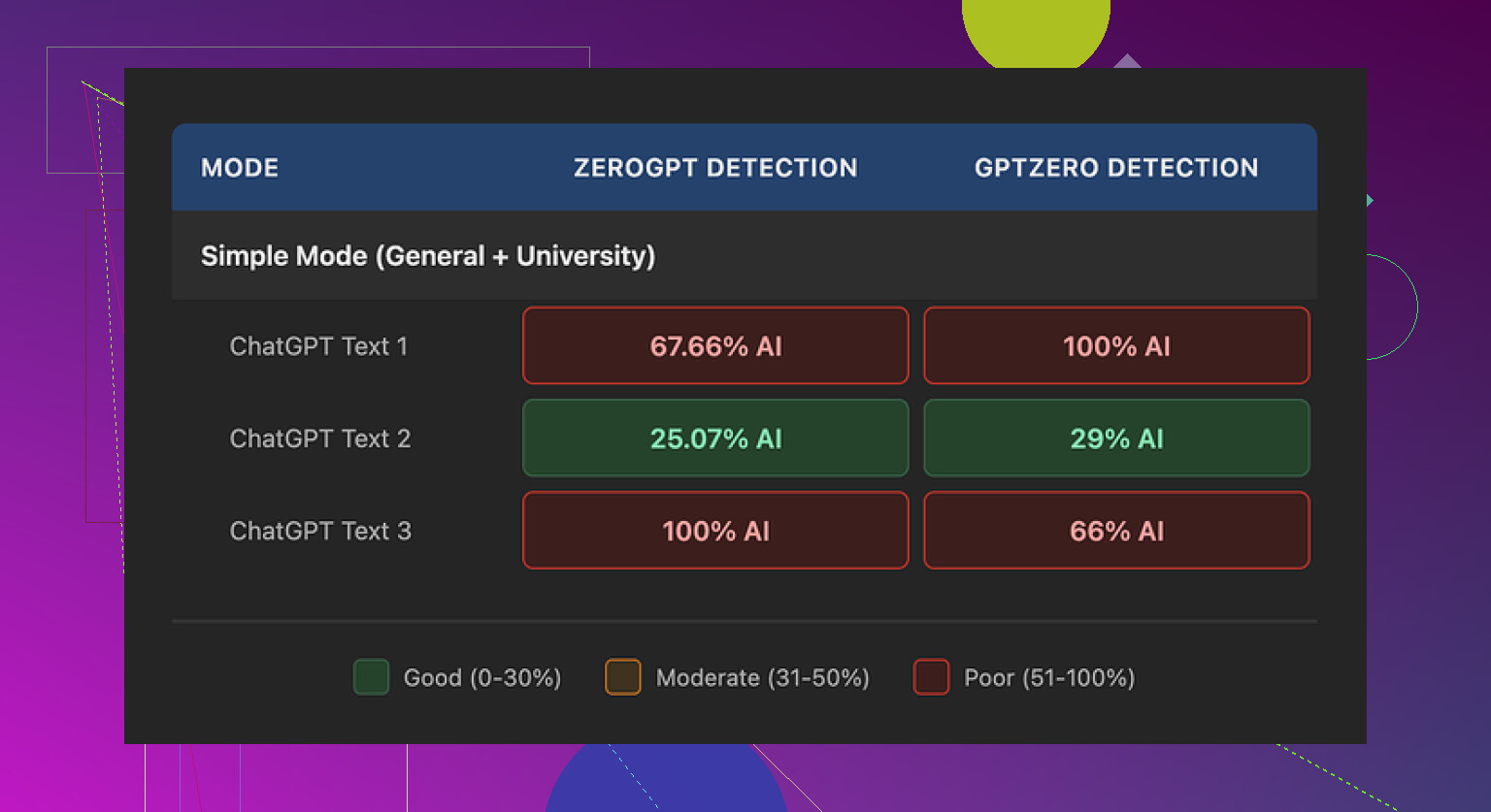

Kurz gesagt, die Ergebnisse sind stark hin- und hergesprungen.

Ein Durchlauf lag bei 29 % auf GPTZero und 25 % auf ZeroGPT, was für einen kostenlosen „Humanizer“ gar nicht schlecht ist. Die meisten kostenlosen Tools, die ich ausprobiert habe, landen eher bei 70–100 % AI bei mindestens einem Checker. Dieser eine Test sah also vielversprechend aus.

Dann haben mich die beiden anderen Durchläufe mit der klassischen Ohrfeige erwischt. Beide wurden von mindestens einem Detektor als 100 % AI eingestuft. Gleicher Quelltext, gleicher Simple-Modus, andere Outputs, völlig unterschiedliche Erkennungswerte.

Zur Fairness: Ich hatte nur Zugriff auf den kostenlosen Simple-Modus. Die „Standard“- und „Enhanced“-Bypass-Stufen sind hinter einem kostenpflichtigen Plan gesperrt und sollen bei Detektoren besser abschneiden. Ich habe diese nicht getestet, daher kann ich nicht sagen, ob sie die Inkonsistenz beheben oder nicht.

Hier ist aber, was mich mehr gestört hat als die Werte selbst.

Wie der Text wirkte

Wenn man aufhört, nur auf die Erkennungszahlen zu starren, und den Text wirklich liest, springen ein paar Muster sofort ins Auge.

Das ist mir immer wieder aufgefallen:

• Überall Semikolons, an Stellen, an denen eine normale Person eher ein Komma setzen oder den Satz trennen würde. Es sah etwa so aus:

„Das Wetter verändert sich rasant; in vielen Regionen; merken die Menschen stärkere Stürme; und heißere Tage.“

Das liest sich steif und unnatürlich. So schreiben Menschen außerhalb von AI-Ausgaben selten.

• In einem Sample wurde das Wort „heute“ viermal in drei Sätzen verwendet. Es wirkte in etwa so:

„Heute stehen Menschen vor neuen Herausforderungen. Heute prägt Technologie den Alltag. Heute haben Entscheidungen mehr Gewicht.“

Diese Art von Wiederholung ist ein klarer Hinweis auf AI-Text.

• Wiederkehrende Klammerformulierungen, besonders der Klassiker im Stil „(z. B. Stürme, Dürren)“. Die Struktur „(z. B. X, Y)“ tauchte immer wieder auf. Gleiches Muster, gleicher Rhythmus, gleicher generischer Modell-Vibe.

Wenn dein Ziel ist, bei einer händischen Prüfung durch einen Lektor oder Lehrer durchzukommen, fällt so ein Schreibstil sofort auf. Man müsste viel davon von Hand bereinigen oder größere Teile umschreiben.

Preise und Limits

Das habe ich mir zu den Tarifen zum Testzeitpunkt notiert:

• Starter-Plan: beginnt bei etwa 8 $ pro Monat bei jährlicher Zahlung, mit 30.000 enthaltenen Wörtern.

• Unlimited-Tarif: etwa 26 $ pro Monat, als „unbegrenzt“ bezeichnet, aber jede Eingabe ist auf 2.000 Wörter begrenzt.

Dieses Limit pro Einreichung ist relevant. Wenn du mit langen Essays, Berichten oder Blogartikeln arbeitest, musst du den Text in Teile schneiden, Abschnitt für Abschnitt durchjagen und danach alles wieder zusammenfügen – und versuchen, den Stil konsistent zu halten.

Details zum Gratis-Tarif aus meinem Test:

• Insgesamt 300 Wörter enthalten. Nicht pro Tag, insgesamt.

• Nur Simple-Modus verfügbar, kein Zugriff auf die angeblich stärkeren Bypass-Stufen.

Richtlinien und Datenthemen

Zwei Punkte haben mich stutzig gemacht.

• Der Abschnitt zu Rückerstattungen war sehr scharf formuliert, inklusive Drohungen mit rechtlichen Schritten bei Chargebacks. Ich verstehe, dass Anbieter Streitfälle hassen, aber der Ton wirkte für ein Abo-Tool ziemlich feindselig.

• Der Umgang mit eingereichten Texten war vage beschrieben. Ich habe keine klare, einfache Erklärung gesehen, wie lange sie deinen Text speichern, ob sie ihn für Training nutzen oder wie du ihn löschen kannst. Bei Schulaufgaben, Kundeninhalten oder sensiblen Sachen will man das genau wissen.

Wenn du vertrauliche Texte durch irgendeinen Drittanbieter-Humanizer laufen lassen willst, lies die Infos zu Datenschutz und Aufbewahrungsdauer sehr genau. Wenn es unklar ist, würde ich keine echten Namen, Kundendaten oder irgendetwas eingeben, dessen Leak dir schaden könnte.

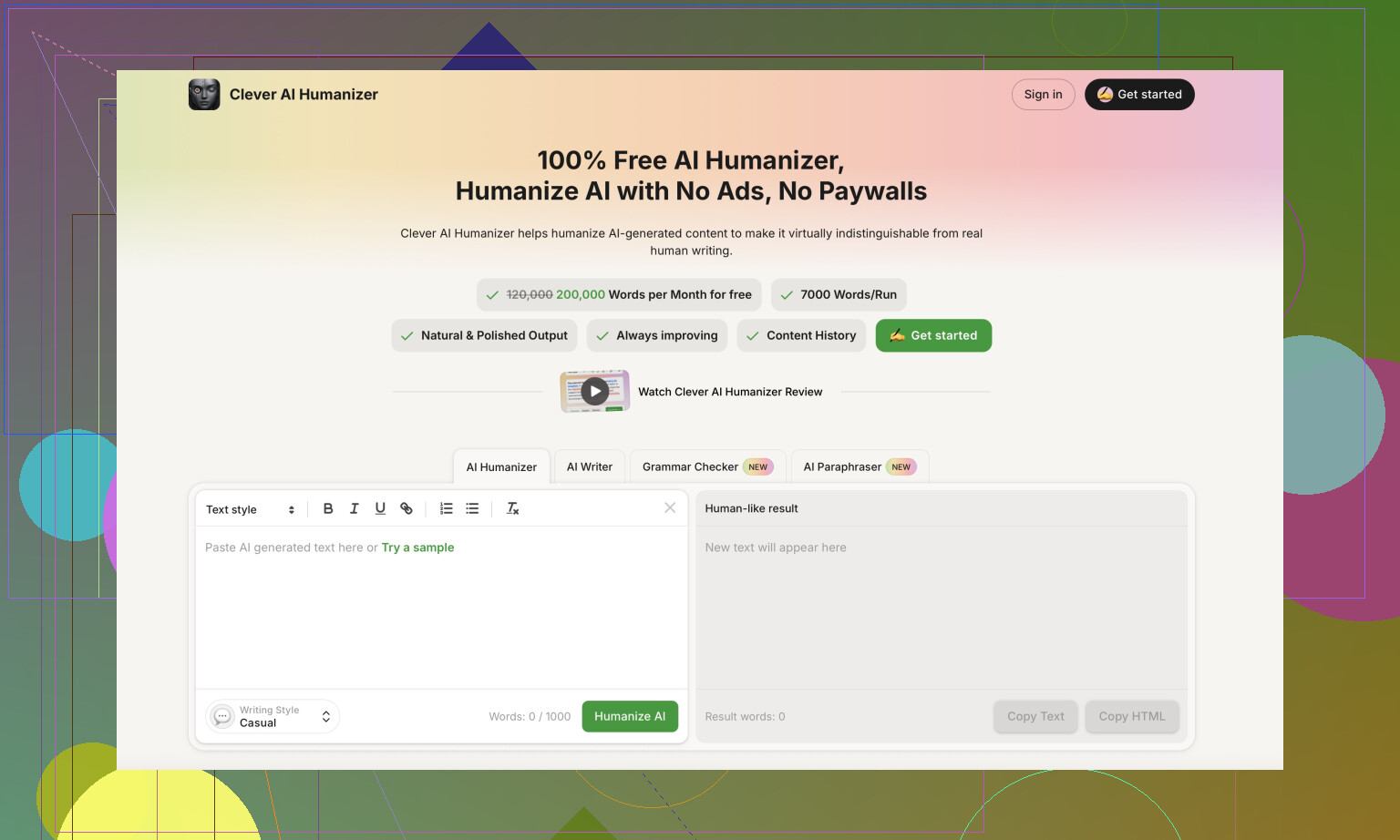

Was für mich besser funktioniert hat

Im gleichen Testdurchlauf habe ich Clever AI Humanizer mit denselben Arten von Eingaben ausprobiert.

Für mich klang der Output näher daran, wie Menschen tatsächlich schreiben, und das Tool wollte kein Geld.

Du findest es hier:

Ich habe es parallel mit Detektoren genutzt und mochte die Balance aus Lesbarkeit und „menschlichem“ Stil deutlich mehr als das, was ich aus dem kostenlosen Modus von Walter Writes AI bekommen habe. Ich habe die Ausgaben trotzdem von Hand bearbeitet, aber ich musste weniger robotische Formulierungen und weniger offensichtliche Muster ausbügeln.

Mehr Quellen, wenn du tiefer einsteigen willst

Wenn du Walkthroughs und Tests von anderen sehen willst, haben mir diese geholfen:

Humanize-AI-Anleitung auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=de

Clever-AI-Humanizer-Review-Thread auf Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=de

YouTube-Video-Review

Wenn du Walter Writes AI in einem bezahlten Tarif ausprobierst und andere Ergebnisse bekommst, speichere deine Screenshots der Detektoren und vergleiche sie über mehrere Tools hinweg. Die Werte springen stärker, als viele denken, und man sollte sie eher als Hinweise sehen, nicht als endgültiges Urteil.

Kurze Antwort aus meinen Tests und der Arbeit mit Kunden im letzten Monat: Walter Writes AI ist unzuverlässig, wenn dein Hauptziel ist, bei langen Texten Detektoren zu umgehen und keinen Ärger zu bekommen.

Ich hatte ähnliche Ergebnisse wie @mikeappsreviewer, habe aber stärker mit langen Essays und Blogartikeln zwischen 1.500 und 3.000 Wörtern gearbeitet.

Das habe ich gesehen, mit Fokus auf Detektoren und reale Nutzung:

- Ergebnisse bei Detektoren in der Praxis

• GPTZero bei 5 verschiedenen langen Artikeln:

- 2 Texte wurden als überwiegend KI oder wahrscheinlich von KI verfasst markiert.

- 3 Texte schwankten, Sätze wurden als zu geringe Perplexität markiert, insgesamt 60 bis 90 Prozent KI.

• ZeroGPT bei denselben Texten: - Ein Output lag bei etwa 20 Prozent KI, der Rest lag über 80 Prozent.

• Copyleaks (Bezahlaccount) war noch strenger, jeder von mir getestete Walter‑Output wurde als hohe KI‑Wahrscheinlichkeit markiert.

Man bekommt also gelegentlich ein Ergebnis, das menschlich wirkt, aber darauf lässt sich kein verlässlicher Workflow aufbauen. Für die Schule oder anspruchsvolle Kunden, die Detektoren einsetzen, ist das zu riskant.

- Probleme bei langen Texten

Wenn man längere Artikel durch Walter laufen lässt, neigt der Text dazu:

• Satzanfänge zu wiederholen. Formulierungen wie In den letzten Jahren oder Heute oder Andererseits tauchen ständig auf.

• Über Absätze hinweg denselben Rhythmus zu behalten. Der Fluss wirkt leicht robotisch, selbst wenn die Wörter geändert werden.

• Eigenartige Zeichensetzung zu nutzen. Ich habe nicht so viele Semikolons gesehen wie @mikeappsreviewer, aber mir sind lange Ketten von Kommas aufgefallen, wo die meisten Menschen zwei Sätze machen würden.

Auch ohne Detektoren erkennt ein menschlicher Prüfer diesen Stil schnell. Für Schulen ist das ein größeres Risiko als die Tools.

-

Bypass‑Stufen und Bezahlpläne

Ich habe Standard und Enhanced in einem bezahlten Monat getestet. Sie wirkten etwas weniger steif als Simple, aber die Kernprobleme blieben.

• Manche Abschnitte kamen bei GPTZero öfter durch, wurden dann aber von Copyleaks oder ZeroGPT trotzdem als KI markiert.

• Das Limit von 2.000 Wörtern pro Einreichung ist für echte Langtexte nervig. Man landet bei Teil 1 klingt so und Teil 2 klingt etwas anders, was für Lektoren oder Dozenten, die eine einheitliche Stimme erwarten, ungünstig ist. -

Wenn du es trotzdem nutzen willst

Falls du auf Walter angewiesen bist, hat mir Folgendes bei Essays die Erkennungsrate etwas gesenkt:

• Mit ordentlichem Ausgangstext starten, nicht mit komplettem KI‑Kauderwelsch.

• Walter nur auf kürzere Abschnitte von 300 bis 600 Wörtern anwenden, dann selbst zusammenfügen und Übergänge leicht umschreiben.

• Satzlängen von Hand verändern. Einige kurze, knackige Sätze zwischen die längeren setzen.

• Offensichtliche KI‑Krücken entfernen. Wiederholte Satzanfänge streichen, generische Phrasen wie in der heutigen Welt und überstrapazierte Klammerbemerkungen rausnehmen.

• Einmal durch einen Detektor laufen lassen, dann manuell nachbessern und erneut testen. Das kostet Zeit, senkt aber das Risiko der Erkennung.

- Bessere Option für dieses konkrete Ziel

Für Ich brauche diesen Text möglichst menschlich und weniger wie GPT hatte ich konstantere Ergebnisse mit Clever AI Humanizer.

Das Tool erzeugte weniger klare Muster, und der Fluss wirkte näher an typischen Texten von Studenten oder Content‑Textern. Ich habe immer noch redigiert, aber mehr an den Inhalten gearbeitet und weniger an der Beseitigung robotischer Formulierungen.

Wenn deine Priorität ist:

• KI‑Detektoren von Kunden zu bestehen,

• Ärger mit Lehrkräften zu vermeiden,

• nicht die Hälfte des Textes nachher neu schreiben zu müssen,

ist Walter Writes AI eher Glücksspiel als Lösung. Sieh es als Helfer, dessen Output du noch stark nachbearbeiten musst, nicht als Ein‑Klick‑Bypass für Detektoren.

Kurze Antwort: Wenn deine Hauptanforderung ist „dies muss bei Langtexten zuverlässig AI‑Detektoren bestehen“, wäre Walter nicht das Werkzeug, auf das ich setzen würde.

Ich bin größtenteils im selben Lager wie @mikeappsreviewer und @nachtdromer, was die Ergebnisse angeht, aber aus leicht anderen Gründen.

Was ich in meinen eigenen Tests gesehen habe (Blog‑ähnliche Inhalte mit 1–2k Wörtern und ein paar Probeaufsätze):

- Verhalten der Detektoren

- Die Bewertungen waren über Tools und Durchläufe hinweg extrem inkonsistent.

- Ein 1,2k‑Artikel, der für mich so halbwegs in Ordnung aussah, wurde von 3 verschiedenen Detektoren als „wahrscheinlich KI“ eingestuft, selbst nachdem ich Walters stärkere Modi genutzt hatte.

- Ein anderer, kürzerer Text mit 700 Wörtern kam bei einem Detektor mit niedriger KI‑Wahrscheinlichkeit durch, aber Copyleaks und ein weiterer Checker haben praktisch „KI‑generiert“ geschrien.

Dieses ganze „Bypass‑Level“ fühlt sich also eher an, als würde nur der Stil des Outputs verändert, ohne die Detektoren wirklich auszuschalten.

- Stilproblem, das Detektoren und Menschen gleichermaßen nervt

Wo ich den anderen ein bisschen widerspreche, ist, dass ich nicht glaube, dass nur die Semikolons oder die Wiederholung von „heute“ das eigentliche Problem sind. Das tiefere Problem ist, dass Walter auf Absatzebene einen sehr gleichmäßigen Rhythmus beibehält:

- ähnliche Satzlänge

- ähnliche Verbindungswörter

- derselbe „sanft erklärende“ Ton über den gesamten Text hinweg

Detektoren springen auf diese geringe Varianz an, und Lehrkräfte und Redakteure ebenso. Selbst wenn die Formulierungen okay wirken, ist der Rhythmus zu gleichförmig. Menschliches Schreiben hat normalerweise mehr Ausschläge: kurze, abgehackte Zeilen, dann einen langen Satz, dann einen etwas verworrenen Satz, der „eigentlich“ redigiert werden müsste, es aber nicht wird.

- Langform ist der Bereich, in dem es am stärksten auseinanderfällt

Du hast Langform‑Inhalte für Kundschaft / Hochschulen / Suche erwähnt. Genau dort hat Walter die größten Probleme:

- Über 1k Wörtern werden die Muster extrem offensichtlich.

- Ab etwa 1,5–2k Wörtern fühlen sich die Absätze austauschbar an, als könnte man sie mischen, ohne dass sich etwas ändert.

Diese Art von blasser Gleichförmigkeit löst zwar nicht immer jeden Detektor aus, aber sie wird von einer anspruchsvollen Professorin oder einem erfahrenen Content‑Manager markiert, der KI‑Texte schon oft gesehen hat.

- Zu Suchmaschinen

Es gibt das Missverständnis „AI‑Detektoren bestehen = sicher für Google“. Nicht wirklich. Google verlässt sich nicht auf diese öffentlichen Detektoren und achtet viel stärker auf:

- Nützlichkeit

- Originalität

- Tiefe und Spezifität

In meinen Tests waren Walters Ausgaben generisch, oberflächlich und arm an einzigartigen Beispielen oder persönlichen Details. Selbst wenn sie einen Klassenzimmer‑Detektor austricksen würden, wären sie im Hinblick auf Suchperformance schwache Inhalte.

- Was tatsächlich hilft, falls du es trotzdem nutzen willst

Ich würde deinen Workflow nicht auf „One‑Click‑Humanize & Abschicken“ aufbauen, aber wenn du es verwenden musst:

- Nutze es nur für kleinere Textblöcke (300–500 Wörter) und füge sie selbst zusammen.

- Füge echte, nachprüfbare Details ein: Daten, Nischenbeispiele, konkrete Orte, einen kurzen persönlichen Blickwinkel.

- Brich den Rhythmus bewusst: füge abrupt kurze Sätze ein, dann einen längeren, etwas chaotischen.

- Lass ein bisschen Unperfektheit zu. Ultra‑sauberer, neutraler Text wirkt in Schule und Kundentexten verdächtig.

- Eine Alternative, die sich lohnt anzuschauen

Wenn dein Ziel buchstäblich „es soll mehr wie von einem Menschen geschrieben wirken“ ist, hatte ich mit Clever AI Humanizer mehr Erfolg. Nicht perfekt, aber:

- Die Satzvielfalt war besser.

- Weniger sich wiederholende Satzanfänge.

- Der Fluss fühlte sich eher so an, wie eine echte Studentin oder ein echter Freelancer unter Zeitdruck entwerfen würde.

Du musst trotzdem noch selbst überarbeiten, aber ich habe weniger Zeit damit verbracht, gegen robotische Formulierungen anzukämpfen als bei Walter. Wenn dir sowohl das Umgehen von AI‑Detektoren als auch gute Lesbarkeit wichtig sind, ist eine Kombination aus Clever AI Humanizer + eigener Überarbeitung deutlich sinnvoller, als dich allein auf Walter zu verlassen.

TL;DR: Walter Writes AI schlüpft gelegentlich durch Detektoren, aber nicht zuverlässig genug für irgendetwas mit hohem Risiko. Für Langform‑Texte, die sowohl automatisierte Prüfungen als auch menschliche Augen überstehen müssen, taugt es höchstens als grobes Hilfstool, nicht als Schutzschild.

Walters größter Fehler bei diesem ganzen „Besteht es die AI‑Detektoren?“-Thema ist nicht nur seine mal guten, mal schlechten Ergebnisse, sondern die Tatsache, dass es dich in einen reaktiven Workflow zwingt.

@nachtdromer, @hoshikuzu und @mikeappsreviewer haben die Zufälligkeit bei GPTZero, ZeroGPT, Copyleaks usw. schon abgedeckt. Ich stimme größtenteils zu, aber ich finde, dass die Leute sich zu sehr auf die Detector‑Screenshots und zu wenig auf Nachvollziehbarkeit und Workflowerisiko konzentrieren.

Wenn du für Schule oder Kunden arbeitest, zählen im Kern diese drei Perspektiven:

- Forensik & Versionsverlauf

Wenn dein Professor oder Kunde die Dokumentenhistorie nutzt (Google Docs, Word‑Versionen), ist ein reiner „in Walter einfügen, wieder herauskopieren“-Workflow problematisch. Der Sprung vom groben Entwurf zum ultrageschliffenen Walter‑Output wirkt verdächtig, selbst wenn die Detektoren „menschlich“ sagen.

Ein sichereres Muster ist:

- erstelle selbst einen chaotischen, aber echten Entwurf

- nutze einen Humanizer, Walter oder etwas anderes, nur auf ausgewählte Absätze

- überarbeite dann im selben Dokument, sodass der Verlauf schrittweise Änderungen zeigt

Walter hilft hier nicht, weil seine Stilverschiebung stark und konsistent ist, sodass der Vorher‑/Nachher‑Kontrast groß ausfällt.

- Stimmfingerabdruck

Hier bin ich etwas anderer Meinung als @mikeappsreviewer. Die Semikolons und wiederkehrenden Satzanfänge sind nervig, aber das tiefere Problem ist, dass Walter deine Stimme mit „Walter‑Stimme“ überschreibt. Wenn du bereits Arbeiten abgegeben hast, kann ein Lehrer den Ton über mehrere Aufgaben hinweg vergleichen.

Einige neuere Tools wie Clever AI Humanizer behalten mehr von der ursprünglichen Struktur und den Eigenheiten bei, was hilft, dass dein Schreiben wie eine Weiterentwicklung deiner früheren Arbeiten wirkt und nicht wie der Wechsel zu einem neuen Autor.

Kurz die Vor‑ und Nachteile aus meinen Tests mit Clever AI Humanizer, da ständig nach Alternativen gefragt wird:

Vorteile

- Bessere Satzvielfalt und weniger starre Kadenz, was sowohl Detektoren als auch Menschen mögen.

- Neigt dazu, einige ursprüngliche Formulierungen beizubehalten, statt alles in dieselbe blasse Schablone umzuschreiben.

- Ergebnisse lassen sich leichter in die eigene Stimme umarbeiten, weil sie sich nicht so stark nach einem einzigen, aufgetragenen Stil anfühlen.

- Kostenloser Einstieg, dadurch sinnvoll, um parallel mit verschiedenen Detektoren zu experimentieren.

Nachteile

- Immer noch kein magischer Tarnmantel. Lange, vollständig AI‑getriebene Aufsätze können trotzdem Detektoren auslösen, wenn du keine echten Ideen und Details hinzufügst.

- Führt manchmal etwas unbeholfene Wortwahl ein, die du von Hand korrigieren willst.

- Wie Walter löst es das „Versionsverlauf“-Problem nicht, wenn du riesige Textblöcke auf einmal ersetzt.

- Man wird leicht übermütig, weil es „menschlich“ klingt, und spart sich dann genau die manuelle Nachbearbeitung, die das Risiko tatsächlich reduziert.

- Inhaltliche Tiefe vs. „AI‑Geruch“

Wo ich mich etwas von @hoshikuzu unterscheide, ist, dass ich die Detector‑Scores für weniger wichtig halte als inhaltliche Spezifität. Am schnellsten geraten Leute meiner Erfahrung nach nicht wegen eines Detektors in Schwierigkeiten, der „AI“ ruft, sondern weil der Text so generisch ist, dass Lehrer oder Kunde einfach fragen: „Woher hast du das?“

Wenn du unbedingt Walter, Clever AI Humanizer oder etwas Ähnliches verwenden willst:

- füge konkrete Beispiele ein, die an deinen realen Kontext gebunden sind

- beziehe dich auf Kursmaterial, kundenspezifische Details, deine eigenen Erfahrungen

- lass ein paar leicht holprige Sätze stehen, die nach dir klingen, nicht nach einem stilpolierten Bot

Fazit:

Walter Writes AI kann gelegentlich an einigen Detektoren vorbeirutschen, zwingt dich aber in einen fragilen, screenshot‑fixierten Workflow und hinterlässt einen erkennbaren stilistischen Fingerabdruck. Clever AI Humanizer ist auch nicht perfekt, eignet sich aber besser, um bearbeitbaren, weniger einheitlichen Text zu bekommen, damit du AI‑Hilfe mit deiner echten Stimme mischen kannst.

Wenn dein Ziel ist, zuverlässig lange Texte abzugeben, ohne Tools oder Menschen zu triggern, solltest du vor allem investieren in: gute Anfangsentwürfe, schrittweise Überarbeitung und nur behutsamen Einsatz irgendeines Humanizers – statt Walter als One‑Click‑Bypass zu benutzen.