Estoy probando Walter Writes AI para contenido de formato largo y me preocupa si los artículos que genera realmente pueden pasar los detectores actuales de contenido de IA utilizados por clientes, escuelas y motores de búsqueda. Algunas herramientas indican que el texto parece humano, mientras que otras lo marcan como generado por IA. ¿Alguien puede compartir experiencia en el mundo real, herramientas de detección específicas que hayan probado y consejos prácticos para ajustar el contenido de Walter Writes AI para que sea más seguro para su publicación y para el SEO?

Walter Writes AI: mi opinión honesta después de trastear con la herramienta

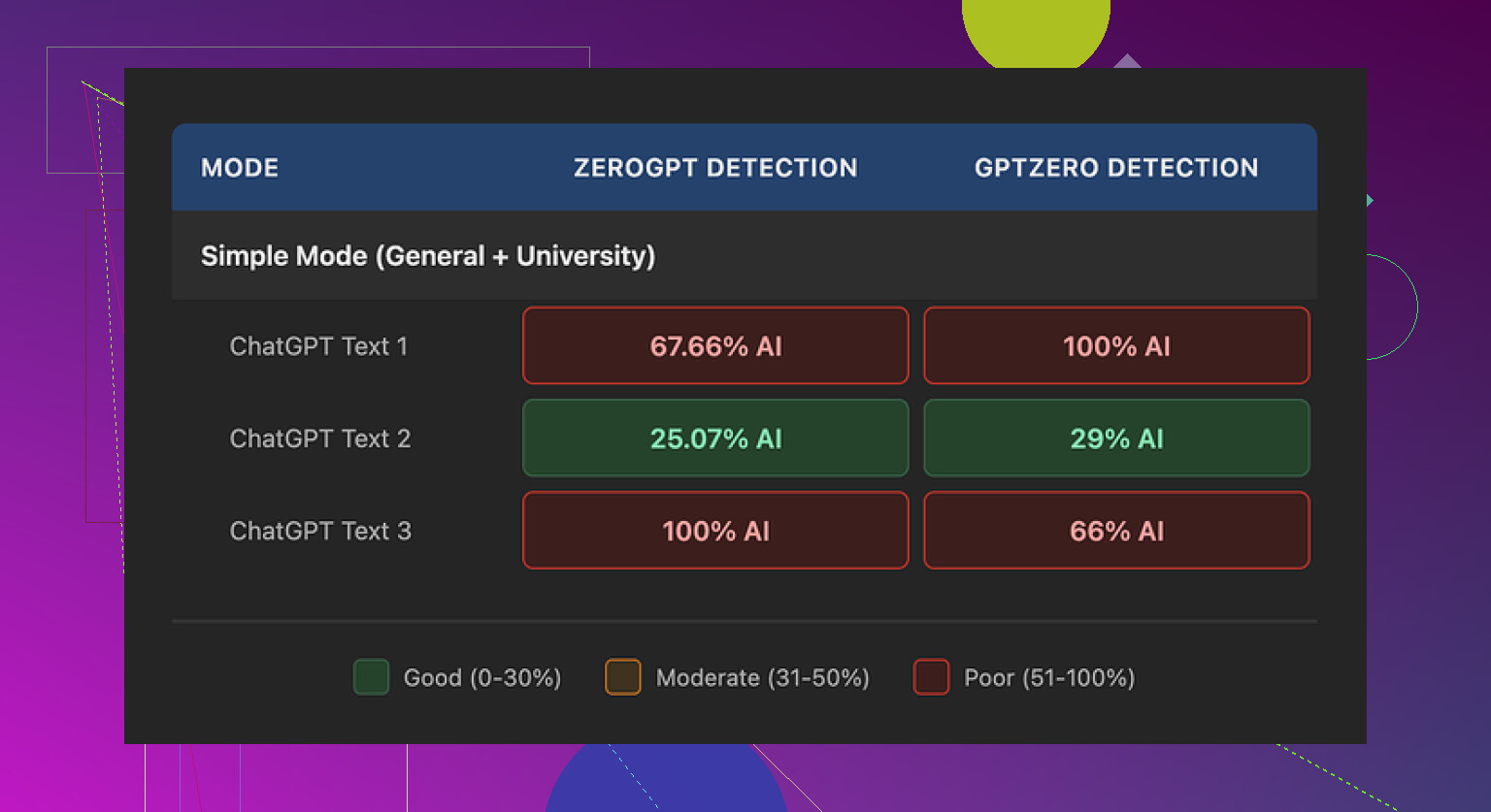

Pasé una tarde poniendo a prueba Walter Writes AI a base de estrés con los típicos detectores de IA que todo el mundo menciona: GPTZero y ZeroGPT.

En resumen, los resultados variaron muchísimo.

En una de las pruebas salió un 29% en GPTZero y un 25% en ZeroGPT, que no está mal para un “humanizador” gratuito. La mayoría de herramientas gratis que he probado se quedan más cerca del 70–100% de IA en al menos uno de los detectores. Así que esa muestra parecía prometedora.

Luego las otras dos pruebas fueron el clásico jarro de agua fría. En ambas, al menos uno de los detectores marcó el texto como 100% IA. Mismo texto de origen, mismo modo Simple, salidas diferentes, puntuaciones de detección totalmente distintas.

Siendo justo, solo tuve acceso a su modo Simple gratuito. Los niveles de bypass “Standard” y “Enhanced” están bloqueados tras un plan de pago y se supone que funcionan mejor frente a los detectores. No probé esos niveles, así que no puedo decir si resuelven la inconsistencia o no.

Sin embargo, hubo algo que me preocupó más que las propias puntuaciones.

Cómo se veía la escritura

En cuanto dejas de mirar solo los números de detección y lees el texto, algunos patrones saltan a la vista muy rápido.

Esto es lo que veía una y otra vez:

• Puntos y coma por todas partes, en sitios donde una persona normal usaría una coma o partiría la frase. Se veía algo así:

“El clima está cambiando rápidamente; en muchas regiones; la gente nota tormentas más fuertes; y días más calurosos.”

Se lee rígido y poco natural. Casi nunca veo a gente escribir así fuera de los textos generados por IA.

• En una muestra se usó la palabra “hoy” cuatro veces en tres frases. Sonaba así:

“Hoy, las personas enfrentan nuevos desafíos. Hoy, la tecnología da forma a la vida diaria. Hoy, las decisiones importan más.”

Ese tipo de repetición delata enseguida que el texto es de IA.

• Frases entre paréntesis repetidas, especialmente el típico estilo “(p. ej., tormentas, sequías)”. La estructura “(p. ej., X, Y)” aparecía una y otra vez. Mismo patrón, mismo ritmo, mismas sensaciones que el texto genérico de modelo.

Si tu objetivo es pasar una revisión manual de un corrector humano o un profesor, este tipo de redacción canta mucho. Tendrías que limpiar bastante a mano o reescribir grandes partes.

Precios y límites

Esto es lo que apunté de sus planes cuando lo probé:

• Plan Starter: empieza alrededor de 8 $ al mes si pagas anual, con 30.000 palabras incluidas.

• Plan Unlimited: unos 26 $ al mes, marcado como “ilimitado”, pero cada envío está limitado a 2.000 palabras.

Ese límite por envío importa. Si trabajas con ensayos largos, informes o posts de blog, acabas troceando el texto, procesándolo por secciones y luego intentando unirlo todo manteniendo un estilo consistente.

Detalles del plan gratuito según mi prueba:

• Un total de 300 palabras incluidas. No al día, en total.

• Solo modo Simple disponible, sin acceso a los supuestos niveles de bypass más potentes.

Política y preocupaciones sobre datos

Hubo dos cosas que me hicieron dudar.

• La sección de reembolsos usaba un lenguaje muy agresivo, incluyendo amenazas de acciones legales en caso de contracargos. Entiendo que a los servicios no les gustan las disputas, pero el tono resultaba hostil para una herramienta de suscripción.

• El manejo de los datos del texto enviado era vago. No vi una explicación clara y sencilla de cuánto tiempo guardan tu texto, si lo usan para entrenar modelos o cómo eliminarlo. Cuando trabajas con tareas escolares, contenido de clientes o datos sensibles, quieres que eso esté muy bien detallado.

Si piensas pasar textos confidenciales por cualquier humanizador de terceros, lee con calma la información sobre privacidad y retención de datos. Si no está clara, yo no le pasaría nombres reales, datos de clientes ni nada que pudiera perjudicarte si se filtra.

Lo que me funcionó mejor

Durante la misma ronda de pruebas, probé Clever AI Humanizer con el mismo tipo de textos.

En mi caso, generó resultados que sonaban más cercanos a cómo escribe la gente y no me pidió pago.

Puedes verlo aquí:

Lo usé a la vez que los detectores y me gustó más el equilibrio entre legibilidad y estilo “humano” que el que obtuve con el modo gratuito de Walter Writes AI. Aun así edité los resultados a mano, pero tuve que corregir menos frases robóticas y menos patrones evidentes.

Más recursos si quieres profundizar en este tema

Si quieres guías y ver pruebas de otras personas, estos recursos me ayudaron:

Tutorial para humanizar IA en Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1l7aj60/humanize_ai/?tl=es-es

Hilo de reseña de Clever AI Humanizer en Reddit

https://www.reddit.com/r/DataRecoveryHelp/comments/1ptugsf/clever_ai_humanizer_review/?tl=es-es

Vídeo de reseña en YouTube

Si pruebas Walter Writes AI en un plan de pago y obtienes resultados distintos, guarda las capturas de los detectores y compara entre varias herramientas. Las cifras bailan más de lo que la gente piensa, y es mejor tratarlas como señales, no como un veredicto definitivo.

Respuesta breve a partir de mis pruebas y del trabajo con clientes durante el último mes: Walter Writes AI es poco fiable si tu objetivo principal es pasar detectores con textos largos y que nadie se queje.

Tuve resultados similares a @mikeappsreviewer, pero me centré más en ensayos y entradas de blog largas, de 1.500 a 3.000 palabras.

Esto es lo que vi, centrándome en detectores y uso real:

- Resultados de los detectores en la práctica

• GPTZero en 5 artículos largos diferentes:

- 2 textos marcados como mayormente IA o probablemente escritos por IA.

- 3 textos iban y venían, frases marcadas con “perplejidad demasiado baja”, en conjunto entre un 60 y un 90 por ciento IA.

• ZeroGPT en los mismos textos: - Una salida rondó el 20 por ciento IA, el resto se mantuvo por encima del 80 por ciento.

• Copyleaks (cuenta de pago) fue aún más duro, todas las salidas de Walter que probé fueron marcadas con alta probabilidad de IA.

Así que sí, puedes conseguir de vez en cuando un resultado que parezca humano, pero no puedes montar un flujo de trabajo basado en golpes de suerte. Para la escuela o clientes exigentes que usan detectores, esto es demasiado arriesgado.

- Problemas de estructura en textos largos

Cuando fuerzas artículos más extensos a través de Walter, el texto tiende a:

• Repetir los comienzos de las frases. Cosas como “En los últimos años” o “Hoy en día” o “Por otro lado” una y otra vez.

• Mantener el mismo ritmo en todos los párrafos. Flujo algo robótico, aunque cambien algunas palabras.

• Usar hábitos raros de puntuación. No vi tantos puntos y coma como @mikeappsreviewer, pero sí muchas cadenas largas de comas donde la mayoría de la gente dividiría en dos frases.

Más allá de los detectores, un revisor humano detecta este estilo muy rápido. Para las escuelas, eso es un riesgo mayor que las propias herramientas.

-

“Niveles de bypass” y planes de pago

Probé Standard y Enhanced durante un mes de pago. Se veían un poco menos rígidos que Simple, pero los problemas principales seguían ahí.

• Algunos fragmentos pasaron GPTZero más a menudo, pero luego Copyleaks o ZeroGPT los marcaban de todos modos.

• El límite de 2.000 palabras por envío es molesto para textos realmente largos. Terminas con una parte 1 que “suena así” y una parte 2 que “suena un poco distinto”, lo cual no es ideal para editores o profesores que esperan una voz consistente. -

Si aun así quieres usarlo

Si estás atascado con Walter, esto fue lo que redujo las tasas de detección en mis ensayos:

• Empieza con un contenido base decente, no con desvaríos sin sentido de IA.

• Usa Walter solo en secciones más cortas, de 300 a 600 palabras, luego une y reescribe tú mismo ligeramente las transiciones.

• Cambia a mano la longitud de las frases. Añade algunas líneas cortas y tajantes entre las más largas.

• Elimina las muletas obvias de IA. Quita comienzos repetidos, frases genéricas como “en el mundo actual” y exceso de paréntesis.

• Pásalo por un detector, retoca a mano, y vuelve a probar. Pierdes tiempo, pero el riesgo de detección baja.

- Opción mejor para este objetivo concreto

Para “necesito que este texto parezca humano y menos como GPT”, obtuve resultados más consistentes con Clever AI Humanizer.

Generó menos patrones evidentes y el flujo se acercaba más al de un estudiante normal o un redactor de contenidos. Seguí editando, pero dediqué más tiempo a las ideas y menos a corregir frases robóticas.

Si tu prioridad es:

• pasar los detectores de IA que usan los clientes,

• mantener a los profesores tranquilos,

• evitar reescribir la mitad del texto después,

entonces Walter Writes AI es más una apuesta que una solución. Trátalo como un asistente al que aún tienes que pulirle mucho el resultado, no como un bypass de detectores de un solo clic.

Respuesta breve: si tu requisito principal es “esto tiene que pasar detectores de IA de forma fiable en textos largos”, Walter no es la herramienta en la que yo confiaría.

En cuanto a resultados, estoy más o menos en la misma línea que @mikeappsreviewer y @nachtdromer, pero por motivos algo distintos.

Esto es lo que vi en mis propias pruebas (contenido tipo blog de 1–2k palabras y un par de ensayos simulados):

- Comportamiento de los detectores

- Las puntuaciones fueron tremendamente inconsistentes entre herramientas y ejecuciones.

- Un artículo de 1.2k que a mí me parecía “medianamente aceptable” fue etiquetado como “probable IA” por 3 detectores distintos, incluso después de pasarlo por los modos más fuertes de Walter.

- Otro texto más corto, de 700 palabras, pasó un detector con puntuación baja de IA, pero Copyleaks y otro verificador prácticamente gritaban “generado por IA”.

Así que todo el tema del “nivel de bypass” se siente más como cambiar el sabor de la salida que como neutralizar realmente a los detectores.

- Problema de estilo que odian tanto detectores como humanos

Donde discrepo un poco de los demás es que no creo que los puntos y coma por sí solos o la repetición de “hoy” sean el verdadero problema. El asunto de fondo es que Walter mantiene un ritmo muy estable a nivel de párrafo:

- longitud de oración similar

- conectores parecidos

- mismo tono “suave y explicativo” en todo el texto

Los detectores captan esa baja variación, y los profesores y editores también. Incluso cuando las palabras suenan bien, la cadencia es demasiado uniforme. La escritura humana suele tener más picos: líneas cortas y tajantes, luego una larga, luego una frase algo desordenada que “debería” editarse pero se queda así.

- El long‑form es donde más se desmorona

Mencionaste contenido largo para clientes / escuelas / búsqueda. Justo ahí es donde Walter más sufre:

- A partir de 1k palabras, los patrones se vuelven muy obvios.

- Entre 1.5–2k, los párrafos empiezan a sentirse intercambiables, como si pudieras barajarlos y nada cambiara.

Ese tipo de uniformidad insípida puede que no dispare siempre todos los detectores, pero sí va a llamar la atención de un profesor exigente o un content manager que ya ha visto textos de IA.

- Sobre los motores de búsqueda

Hay una idea equivocada de que “pasar detectores de IA = estar a salvo con Google”. No es así. Google no se basa en esos detectores públicos, y le importa más:

- utilidad

- originalidad

- profundidad y especificidad

En mis pruebas, los textos de Walter eran genéricos, superficiales y pobres en ejemplos únicos o detalles personales. Aunque engañaran al detector del aula, seguirían siendo contenido débil en términos de rendimiento en búsqueda.

- Qué sí ayuda si aun así quieres usarlo

Yo no basaría tu flujo de trabajo en “humanizar con un clic y enviar”, pero si no te queda otra:

- Úsalo solo en bloques pequeños (300–500 palabras) y haz tú el montaje.

- Inyecta detalles reales y verificables: fechas, ejemplos de nicho, lugares concretos, un ángulo personal breve.

- Rompe el ritmo intencionalmente: mete frases muy cortas y abruptas, luego una más larga y algo desordenada.

- Deja algo de imperfección. El texto ultra limpio y neutro despierta sospechas tanto en la escuela como en trabajos para clientes.

- Alternativa que vale la pena mirar

Si tu objetivo es literalmente “que esto parezca más escrito por una persona”, tuve mejores resultados con Clever AI Humanizer. No es perfecto, pero:

- La variedad de oraciones era mejor.

- Menos inicios de frase repetitivos.

- El flujo se parecía más a cómo escribiría de verdad un estudiante o un freelance con fecha de entrega encima.

Igual tendrás que revisar a mano, pero pasé menos tiempo luchando contra frases robóticas que con Walter. Si te importa evitar detectores de IA y además la legibilidad, una combinación de Clever AI Humanizer + tu propia edición es mucho más sensata que confiar solo en Walter.

TL;DR: Walter Writes AI a veces se cuela entre los detectores, pero no con la consistencia necesaria para algo de alto riesgo. Para textos largos que tienen que superar tanto controles automáticos como revisión humana, trátalo como una ayuda básica, no como un escudo.

El mayor defecto de Walter en todo este asunto de “puede pasar los detectores de IA?” no es solo sus resultados impredecibles, sino la forma en que te obliga a trabajar de manera reactiva.

@nachtdromer, @hoshikuzu y @mikeappsreviewer ya hablaron de la aleatoriedad entre GPTZero, ZeroGPT, Copyleaks, etc. Coincido en gran parte, pero en realidad creo que la gente se está fijando demasiado en las capturas de los detectores y muy poco en la trazabilidad y el riesgo en el flujo de trabajo.

Si haces trabajo para la escuela o para clientes, estos son los tres ángulos que importan:

- Pruebas forenses e historial de versiones

Si tu profesor o cliente usa historial de documentos (versiones de Google Docs, Word), un flujo de trabajo puro de “pegar en Walter, pegar de vuelta” es un problema. El salto de un borrador tosco a una salida súper pulida de Walter se ve sospechoso incluso si los detectores dicen “humano”.

Un patrón más seguro es:

- construir tú mismo un borrador desordenado pero real

- usar cualquier humanizador, Walter u otro, solo en párrafos concretos

- luego revisar dentro del mismo documento para que el historial muestre cambios graduales

Walter no ayuda aquí porque su cambio de estilo es marcado y consistente, así que el contraste entre antes y después es grande.

- Huella de voz

Aquí es donde discrepo un poco de @mikeappsreviewer. Los puntos y coma y los inicios repetidos son molestos, pero el problema de fondo es que Walter sobrescribe tu voz con la “voz de Walter”. Si ya entregaste trabajos anteriores, un profesor puede comparar el tono entre tareas.

Algunas de las herramientas más nuevas, como Clever AI Humanizer, conservan más la estructura y los rasgos raros del original, lo que ayuda a que tu escritura parezca una evolución de tu trabajo previo y no un cambio a un autor nuevo.

Pros y contras rápidos de mis pruebas con Clever AI Humanizer, ya que muchos siguen pidiendo alternativas:

Pros

- Mejor variedad de oraciones y un ritmo menos rígido, algo que gusta tanto a detectores como a personas.

- Tiende a conservar parte del fraseo original en lugar de reescribir todo con la misma plantilla insípida.

- Sus salidas son más fáciles de editar para que suenen a tu propia voz porque no parecen tan “cubiertas” por un estilo fijo.

- Es gratis para empezar, lo que la hace viable para experimentar junto a diferentes detectores.

Contras

- Sigue sin ser una capa de invisibilidad mágica. Ensayos largos generados casi por completo con IA pueden seguir activando detectores si no añades ideas y detalles genuinos.

- A veces introduce elecciones de palabras algo raras que querrás corregir a mano.

- Al igual que Walter, no resuelve el problema del “historial de versiones” si reemplazas bloques enormes de una sola vez.

- Puedes volverte demasiado confiado porque “suena” humano y luego saltarte la edición manual que realmente reduce el riesgo.

- Profundidad del contenido vs “olor a IA”

Donde me aparto un poco de @hoshikuzu es en que creo que las puntuaciones de los detectores importan menos que la especificidad del contenido. La forma más rápida en que he visto meterse a la gente en problemas no es que un detector grite “IA”, sino que el texto es tan genérico que el profesor o cliente simplemente pregunta: “¿De dónde sacaste esto?”

Si insistes en usar Walter, o Clever AI Humanizer, o algo parecido:

- inyecta ejemplos concretos vinculados a tu contexto real

- menciona material de clase, detalles específicos del cliente, tus propias experiencias

- deja un par de frases algo torpes que suenen a ti, no a un bot con estilo pulido

Conclusión:

Walter Writes AI a veces puede colarse bajo algunos detectores, pero te obliga a un flujo de trabajo frágil, basado en perseguir capturas de pantalla, y deja una huella estilística reconocible. Clever AI Humanizer tampoco es perfecto, pero es mejor para darte texto editable y menos uniforme, para que puedas mezclar la ayuda de la IA con tu voz real.

Si tu objetivo es entregar de forma fiable trabajos extensos sin activar ni a las herramientas ni a las personas, tu principal inversión debería ser: buenos borradores iniciales, edición incremental y uso ligero de cualquier humanizador, en lugar de apoyarte en Walter como bypass de un solo clic.